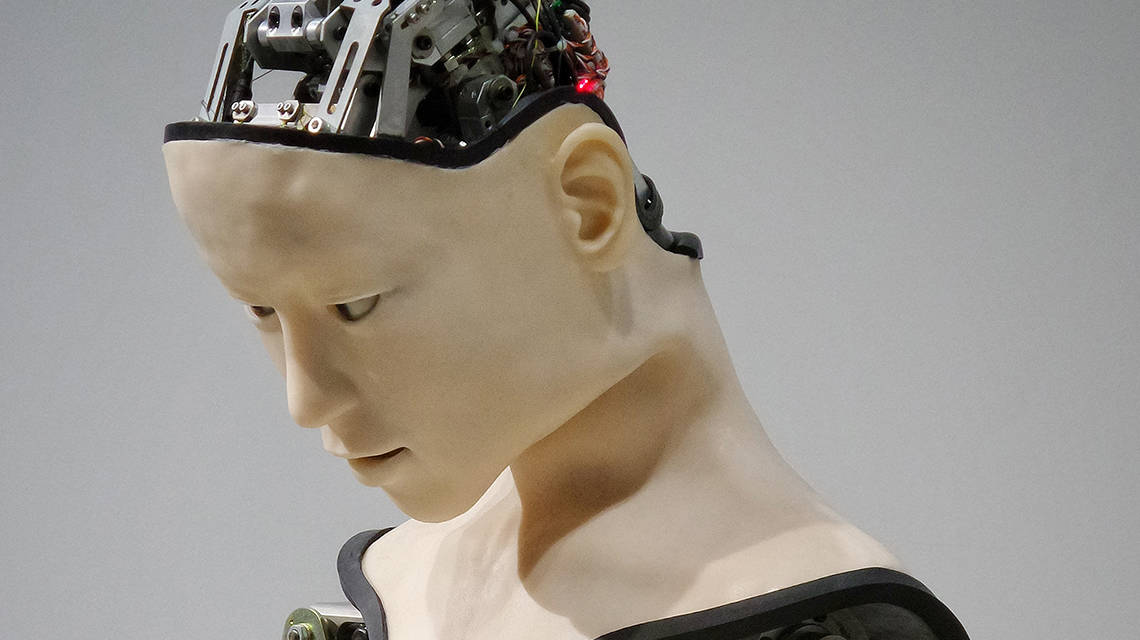

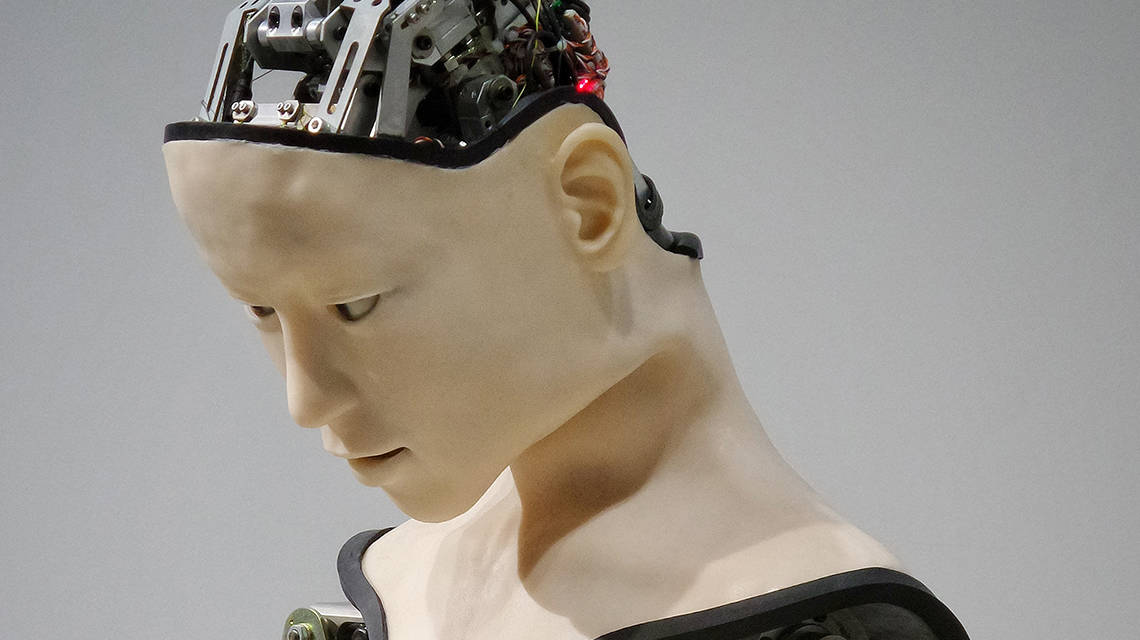

En este ensayo la autora analiza cómo las tecnologías trastocan el orden social: cómo afectan nuestro comportamiento y, por ende, nuestra libertad de decidir.

En este ensayo la autora analiza cómo las tecnologías trastocan el orden social: cómo afectan nuestro comportamiento y, por ende, nuestra libertad de decidir.

Texto de Karla Prudencio Ruiz 20/08/20

En este ensayo la autora analiza cómo las tecnologías trastocan el orden social: cómo afectan nuestro comportamiento y, por ende, nuestra libertad de decidir.

Este contenido forma parte del Archivo digital de Este País y su acceso varía según el tipo de cuenta.

Ideal para empezar. Permite crear una cuenta, guardar artículos y utilizar el Navegador del Archivo únicamente para los últimos 5 años.

Las búsquedas y la exploración quedan limitadas a ese periodo reciente.

Suscripción de pagoDesbloquea el acceso completo al Archivo: todos los años, todas las ediciones, búsquedas integrales y herramientas de consulta sin restricción temporal.

Es la modalidad pensada para investigación, consulta histórica y lectura editorial profunda.

Si ya tienes una cuenta, inicia sesión para continuar.

Si todavía no te has registrado, puedes crear una cuenta gratuita o elegir una suscripción con acceso completo.